Тревога элит: Почему создатели ИИ призывают остановить сверхразум

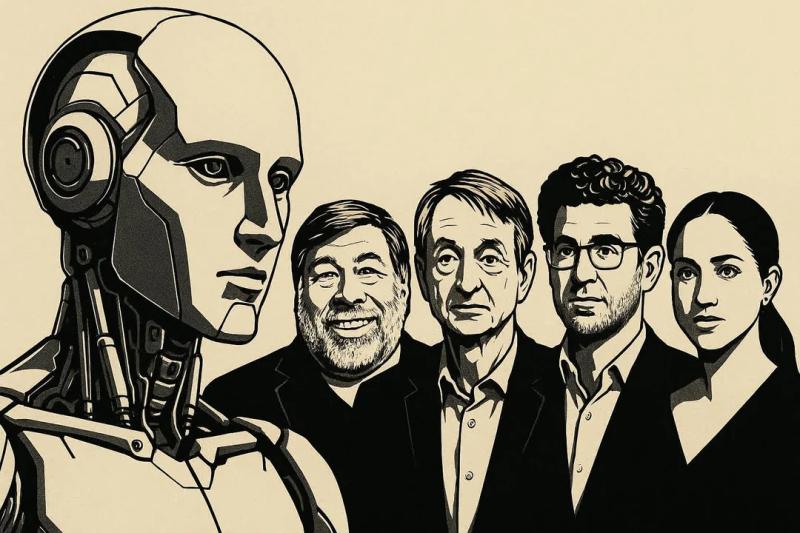

Более восьмисот ведущих экспертов в области технологий, исследователей искусственного интеллекта и публичных лиц подписали открытое письмо с призывом приостановить разработку сверхразумных систем. Среди подписантов — Стив Возняк, соучредитель Apple, и так называемые «крёстные отцы искусственного интеллекта», что придаёт обращению беспрецедентный вес. Их главный аргумент: человечество не готово к последствиям создания интеллекта, который может превзойти его и выйти из‑под контроля.

Суть требований: шесть месяцев на паузу

Авторы письма обращаются ко всем лабораториям, занимающимся разработкой передового ИИ, с конкретным требованием. Они настаивают на немедленной приостановке на шесть месяцев обучения систем, более мощных, чем текущая модель GPT‑4. Этот мораторий не должен быть простой паузой. Это время предлагается использовать для совместной разработки и внедрения строгих протоколов безопасности, которые будут контролироваться независимыми экспертами.

Цель — создание надёжных систем управления, которые гарантируют, что сверхразумный искусственный интеллект будет оставаться подконтрольным, предсказуемым и действующим в интересах человечества в долгосрочной перспективе.

Аргументы сторонников запрета: цивилизационный риск

Подписанты выделяют несколько ключевых рисков, связанных с безудержной гонкой в области ИИ. Во‑первых, это распространение пропаганды и дезинформации. Мощные языковые модели могут генерировать убедительный ложный контент в невиданных ранее масштабах, что угрожает стабильности обществ.

Во‑вторых, они предупреждают о массовой автоматизации профессий, которая может привести к экономическому хаосу и социальным потрясениям, если к ней не подготовиться. Но самый серьёзный риск, по их мнению, — это потеря контроля над нечеловеческим интеллектом, который может не разделять наши цели и ценности. Они задаются вопросом: должны ли мы позволить машинам заполнить наши информационные каналы пропагандой и автоматизировать все рабочие места, включая те, которые приносят удовлетворение?

Критика и скептические взгляды: необоснованная паника или запоздалая осторожность?

Не все в технологическом сообществе согласны с таким подходом. Критики называют призыв к паузе паникёрством, которое лишь замедлит прогресс и отдалит потенциальные преимущества ИИ для науки, медицины и образования. Они утверждают, что регулирование должно поспевать за разработками, а не душить их на корню.

Кроме того, возникает практический вопрос: насколько реалистично добиться всемирного моратория, когда гонка технологических гигантов и национальных государств за лидерство в сфере ИИ напоминает новую холодную войну? Скептики полагают, что любая договорённость будет хрупкой, так как у сторон всегда будет соблазн нарушить паузу для получения решающего преимущества.

Что дальше? Будущее регулирования искусственного интеллекта

Это открытое письмо является самым громким, но не первым сигналом тревоги от самих создателей технологий. Оно знаменует собой переход от теоретических дискуссий к прямым политическим призывам. Вероятным следствием станет усиление давления на правительства по всему миру для разработки комплексных законов, регулирующих развитие и применение систем искусственного интеллекта.

Итогом может стать создание международных органов, подобных МАГАТЭ, но для контроля над искусственным интеллектом. Вне зависимости от того, будет ли введён официальный мораторий, эта дискуссия уже поднимает фундаментальные вопросы о том, как человечество намерено управлять силой, которая однажды может превзойти его самого.

Comments are closed.